В последние годы изображения, видео и тексты, сгенерированные нейросетью, стали частью повседневной жизни. Они выглядят правдоподобно и порой обманывают даже опытных людей. В этой статье я подробно расскажу о реальных приёмах, инструментах и рабочих схемах, которые помогут понять, когда перед вами фейки, созданные нейросетями, и что с ними можно сделать.

Почему современные подделки так легко вводят в заблуждение

Качество генеративных моделей выросло стремительно: параметры сетей увеличились, алгоритмы обучения стали сложнее, а доступность вычислений шире. Результат — изображения и аудио, которые по деталям и освещению не отличишь от записей реального мира.

Параллельно появилось бизнес- и медийное давление: фейки быстро распространяются через социальные сети, где алгоритмы предпочтут эмоциональный контент. Это создаёт среду, в которой неправда распространяется быстрее, чем попытки её опровергнуть.

Виды подделок, которые создают нейросети

Понимание форматов подделок поможет выбрать методы их обнаружения. Разные типы артефактов требуют разных подходов — что работает для фото, может не сработать для голоса.

Далее перечислю основные категории с кратким описанием ключевых признаков, на которые стоит обращать внимание.

Изображения и фото

Генеративные изображения часто содержат мелкие несоответствия: неровные тени, искажённые часы на руке, неправильное количество пальцев или странные отражения. Такие ошибки особенно заметны при внимательном рассмотрении деталей.

Ещё один подсказчик — метаданные. У реальной камеры есть EXIF-информация, у сгенерированного файла она либо отсутствует, либо содержит нетипичные записи. Однако злоумышленник может удалить или подделать метаданные, поэтому проверка EXIF — не панацея.

Видео и дипфейки

Дипфейки объединяют визуальные несоответствия с нарушениями синхронизации звука и движений губ. Часто взгляд или мимика не совпадают с интонацией, особенно в кадрах с быстрыми поворотами головы.

Кроме того, алгоритмы генерации могут «плавить» фон при масштабировании или демонстрировать повторяющиеся артефакты на текстуре кожи. Анализ кадров по частям помогает выявить такие паттерны.

Аудио и синтез речи

Искусственно синтезированный голос может звучать очень натурально, но при длительном прослушивании проявляются повторяющиеся интонации и отсутствие естественных «заминок». Поведение пауз, кашля и дыхания часто выдает синтетическую речь.

Технически посмотреть на спектрограмму — частотный портрет звука. У записи живого человека в спектрограмме больше нерегулярностей, у синтеза часто видны ровные паттерны.

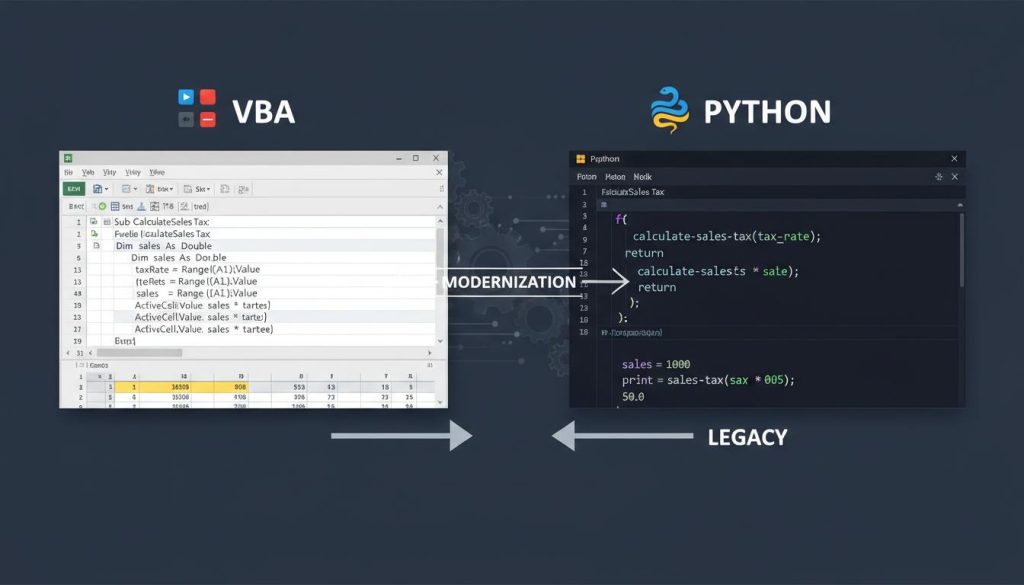

Текст и сгенерированные публикации

Текст, созданный ИИ, может выглядеть связным, но содержать фактические ошибки, несуществующие цитаты или странные источники. Модель может уверенно «врать», подставляя похожие, но неверные данные.

Кроме фактов, характерный признак — однообразная стилистика и повторяющиеся структуры предложений. Проверка фактов и поиск первоисточников остаются ключевым инструментом против таких фейков.

Как распознавать фейки — практические приёмы

Ни один метод не даёт 100% гарантии, но сочетание нескольких подходов заметно повышает шансы обнаружить подделку. Создайте чек-лист и используйте его автоматически при подозрительных материалах.

Ниже — набор приёмов, которые легко использовать как на смартфоне, так и на рабочем компьютере.

- Проверка метаданных: EXIF для фото, контейнерные метаданные для видео и аудио.

- Обратный поиск изображений: Google, Yandex, TinEye помогут найти оригинал или ранние версии кадра.

- Анализ несоответствий: взгляд, руки, фон и тени — простые индикаторы синтеза.

- Спектральный анализ аудио и синхронизация видео/звука.

- Фактчекинг: поиск первоисточников и официальных подтверждений.

Быстрая проверка в три шага

Если у вас мало времени, используйте упрощённую процедуру: 1) проверьте источник публикации, 2) сделайте обратный поиск изображения или фрагмента, 3) попытайтесь найти оригинальную дату и автора. Это сокращает риск ошибочной перепубликации.

Такой минимум эффективен в повседневной работе и для частных пользователей. Часто именно элементарная проверка выдаёт проблему быстрее, чем сложные инструменты.

Инструменты и сервисы для детекции

Существует два класса инструментов: аналитические сервисы, которые ищут технические признаки синтеза, и платформы для проверки фактов. Обе категории дополняют друг друга.

Ниже — небольшая таблица для сравнения основных подходов по критериям скорости, точности и доступности.

| Метод | Скорость | Точность | Доступность |

|---|---|---|---|

| Обратный поиск изображений | Высокая | Средняя | Бесплатно, онлайн |

| Анализ EXIF/метаданных | Высокая | Низкая/средняя | Инструменты на ПК и в браузере |

| Специализированные детекторы ИИ | Средняя | Разная, зависит от модели | Коммерческие и open source |

| Фактчекинг платформ | Низкая | Высокая при профессиональном разборе | Зависит от организации |

Как выбирать сервисы

Критерий выбора простой: используйте несколько независимых инструментов и сравнивайте результаты. Если все показывают на подделку, вероятность высока.

Обращайте внимание на обновления — злоумышленники быстро адаптируются, поэтому детекторы требуют регулярной доводки.

Практические советы для обычных пользователей

Большинство людей сталкиваются с фейками в социальных сетях и мессенджерах. Здесь важна не столько техническая экспертиза, сколько привычки и внимательность.

Ниже — набор простых правил, которые помогут снизить риск стать распространителем ложной информации.

- Не делитесь информацией сразу: подождите 10–15 минут и проверьте источник.

- Ищите первоисточник: если первоисточника нет, относитесь к материалу с осторожностью.

- Проверяйте даты: старые события иногда выдаются за новые с помощью новых подписей и монтажей.

- Сомневайтесь в «слишком хорошем» совпадении: эмоциональные заголовки часто служат манипуляции.

Личный пример

Однажды в рабочей переписке коллега прислал видео с политическим выступлением, которое выглядело неправдоподобно. Я проверил кадры через обратный поиск и обнаружил, что оригинал был из другой страны и другого года. Это спасло нашу команду от поспешного репоста.

Опыт показывает: даже простая привычка проверять источник экономит время и репутацию. Сложных инструментов для этого не требовалось.

Процедуры для журналистов и модераторов

Профессиональный разбор требует шаблонов и процессов: цепочка проверок, разделение обязанностей и стандарты прозрачности. Это снижает риск ошибочного опубликования ложной информации.

Ключевая идея — многослойная проверка: сначала технический анализ, затем фактчекинг и финальное редакционное решение. Каждый этап должен быть документирован.

Рекомендованный рабочий процесс

Пример рабочей схемы: 1) первичный анализ — источник и метаданные, 2) технический срез — анализ пикселей, спектрограмма или лог файла, 3) проверка фактов — источники, интервью, датировки, 4) вынесение вердикта и оповещение аудитории. Такой алгоритм сокращает число ошибок.

Важно также иметь список доверенных экспертов и лабораторий, к которым можно обратиться за более глубоким анализом.

Юридические и этические меры

Технологии обогащают возможности, но одновременно ставят вопросы ответственности. Законодатели и платформы пытаются найти баланс между свободой выражения и защитой от вреда.

Практические шаги в этой области включают обязательную маркировку синтетического контента, требования к прозрачности моделей и санкции за злоупотребление. Это не решит проблему мгновенно, но создаёт барьеры для массовых злоупотреблений.

Что уже работает в мире

Некоторые платформы вводят метки для контента, созданного с помощью искусственного интеллекта, и инструменты для массового удаления очевидных нарушений. Законодатели в ряде стран обсуждают обязательную регистрацию крупномасштабных генеративных систем.

Однако технологии опережают регуляцию, поэтому важно сочетать правовые инициативы с образованием пользователей и техническими решениями у разработчиков нейросетей.

Как разработчики и производители ИИ могут снизить риски

Производители моделей несут свою долю ответственности: они могут внедрять механизмы маркировки, водяные знаки и встроенные детекторы, которые помогают платформам и пользователям отличать синтез от реальности.

Универсальный подход — создавать API для верификации происхождения контента. Такой стандарт помог бы объединить усилия разных игроков и упростить проверку.

Пошаговое руководство: что делать, если вы наткнулись на возможный фейк

Ниже — конкретный сценарий действий, который можно распечатать или сохранить на телефоне. Он пригоден для личного использования и для работы в редакции.

- Оцените источник: кто публикует и с какими мотивами. Если источник неизвестен, начинайте с осторожности.

- Сделайте обратный поиск изображения или ключевых кадров видео. Это быстро показывает, существует ли аналогичный материал раньше.

- Проверьте метаданные файла. Если метаданные отсутствуют или выглядят подозрительно, это повод для дополнительной проверки.

- Используйте детектор ИИ и сопутствующие инструменты. Сравните выводы нескольких сервисов.

- Фактчекинг: найдите первоисточник утверждений, цитат и фактов. Если подтверждений нет — не перепостите.

- При необходимости свяжитесь с автором оригинального материала или экспертами в теме.

- Если это подтверждённый фейк, пометьте его или сообщите платформе и контактам, чтобы ограничить дальнейшее распространение.

Культура и образование как фундамент защиты

Технические барьеры важны, но массовая защита от фейков строится на грамотности пользователей. Образование должно научить людей проверять информацию, не доверять эмоциям и понимать базовые принципы генерации контента.

Школьные программы и корпоративные тренинги должны включать практические занятия: как проверять изображения, читать метаданные и сопоставлять источники. Этот навык важнее любой отдельной технологии.

Этические дилеммы и долгосрочная перспектива

Даже если удаётся идентифицировать подделки, остаётся вопрос: как реагировать, чтобы не усиливать вред. Публикация разоблачения иногда может распространять оригинальный фейк дальше. Выбор тональности и канала имеет значение.

Долгосрочно мы придём к сочетанию технической маркировки, правовых норм и культуры ответственности. Пока что важно действовать осознанно и системно.

FAQ

1. Как быстро понять, что фото могло быть сгенерировано нейросетью?

Обратите внимание на детали: неестественные тени, искажения в зеркалах и на руках, странные зубы или уши. Сделайте обратный поиск по изображению и посмотрите EXIF-данные. Совокупность таких признаков чаще всего говорит о синтезе.

2. Можно ли полностью полагаться на детекторы ИИ?

Нет. Детекторы полезны, но дают ложные срабатывания и пропуски. Лучше использовать их в комбинации с обратным поиском, проверкой источников и человеческой экспертизой, особенно в спорных случаях.

3. Как распознать фейковую аудиозапись?

Слушайте на предмет повторяющихся интонаций, равномерных пауз и отсутствия фоновых шумов там, где они ожидаются. Анализ спектрограммы и проверка синхронизации речи с видео помогают обнаружить синтез.

4. Что делать, если я обнаружил фейк в соцсети?

Сначала соберите доказательства: скриншоты, обратные ссылки, метаданные. Затем сообщите платформе через встроенные инструменты и опишите проблему. Не делайте громких публичных разоблачений без подтверждений, чтобы не расширять охват поддельного контента.

5. Как защитить свою организацию от распространения фейков?

Внедрите стандарты верификации контента, обучайте сотрудников и используйте автоматические фильтры на входящем потоке информации. Наличие контактного списка экспертов и процедур быстрого реагирования снижает риски.

Поддельный контент, созданный с помощью искусственного интеллекта, — не только технологическая задача, но и культурная. Тонкая смесь технических инструментов, юридических мер и привычек ответственного поведения даёт шанс сохранять доверие в медиапространстве. Начните с простых проверок и выработайте собственный алгоритм действий: он спасёт вас от лишнего стресса и неправильных решений.